1. 环境安装

以Debian为例,配置好SSH-KEY(本机 -> 服务器免密码登录),提前注册号阿里云百炼模型、Kimi模型、DeepSeek模型、bigmodel(GLM)等模型的账号,该实名实名,该充值充值(Kimi充值才能解速)。

1.1. 安装nvm

sudo apt update

sudo apt upgrade

// 安装依赖

sudo apt install build-essential libssl-dev

// 安装nvm

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/master/install.sh | bash

// 重新打开session即可。

// 安装nodejs 24

nvm install 24

// 切换到nvm

nve use 241.2. 安装git

sudo apt install git -y2. 安装OpenClaw

本篇使用npm的方式安装

如果你的服务器没有配置ssh-key到github,那么你还需要配置一下,将ssh替换为https

git config --global url."https://github.com/".insteadOf ssh://git@github.com/

git config --global url."https://".insteadOf git://然后再进行安装

npm install -g openclaw@latest

openclaw onboard --install-daemon对比其他一键安装的方式,个人更偏向这种方式,对于新手小白,建议使用一键安装脚本

// 脚本负责节点检测、安装和引导

curl -fsSL https://openclaw.ai/install.sh | bash

//或者 只安装二进制

curl -fsSL https://openclaw.ai/install.sh | bash -s -- --no-onboard

3. 配置OpenClaw

3.1 安全加固免责申明。

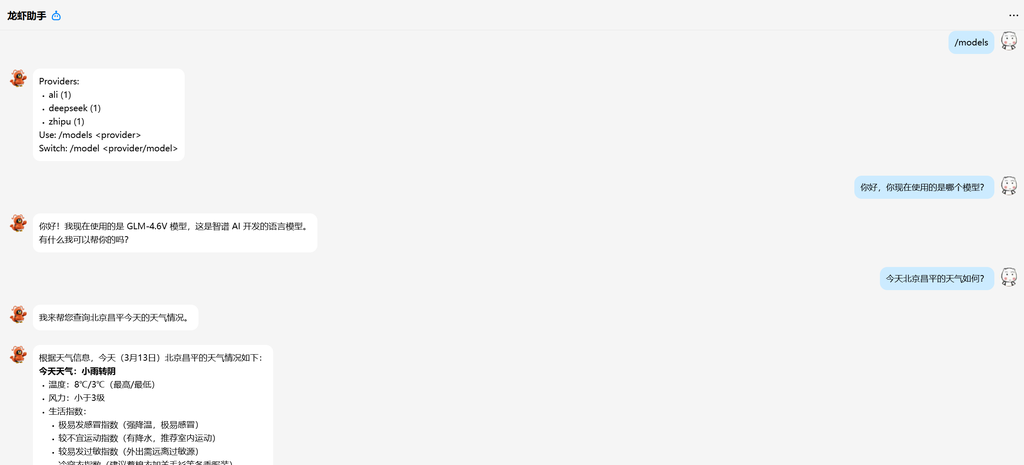

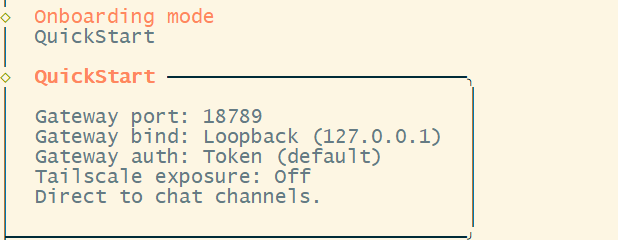

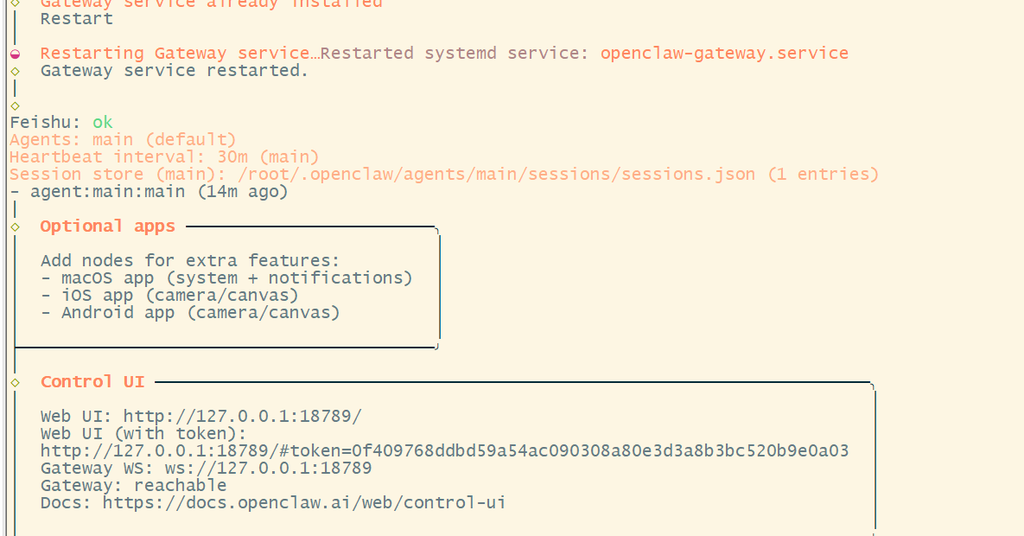

在上一步中,执行了openclaw onboard --install-daemon 命令后,会打开如下所示的内容:

这里通过方向键,选择Yes,回车。

3.2 Onboarding mode(引导模式)

这里选择QuickStart即可。

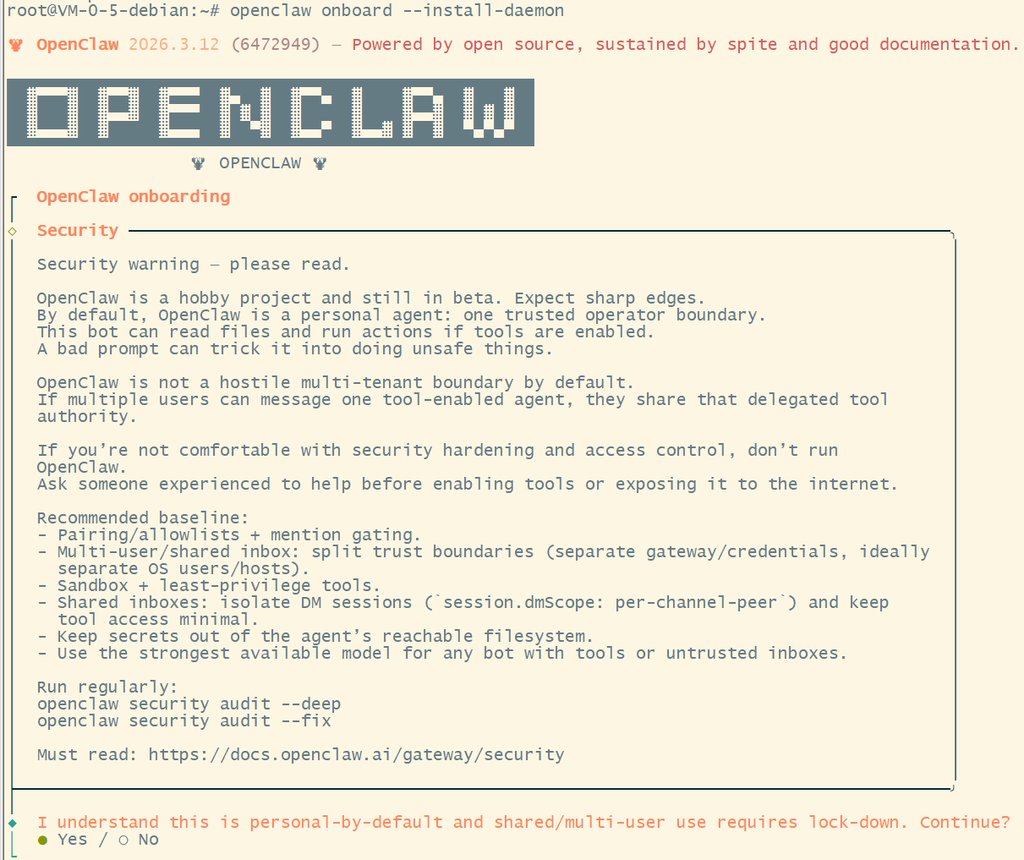

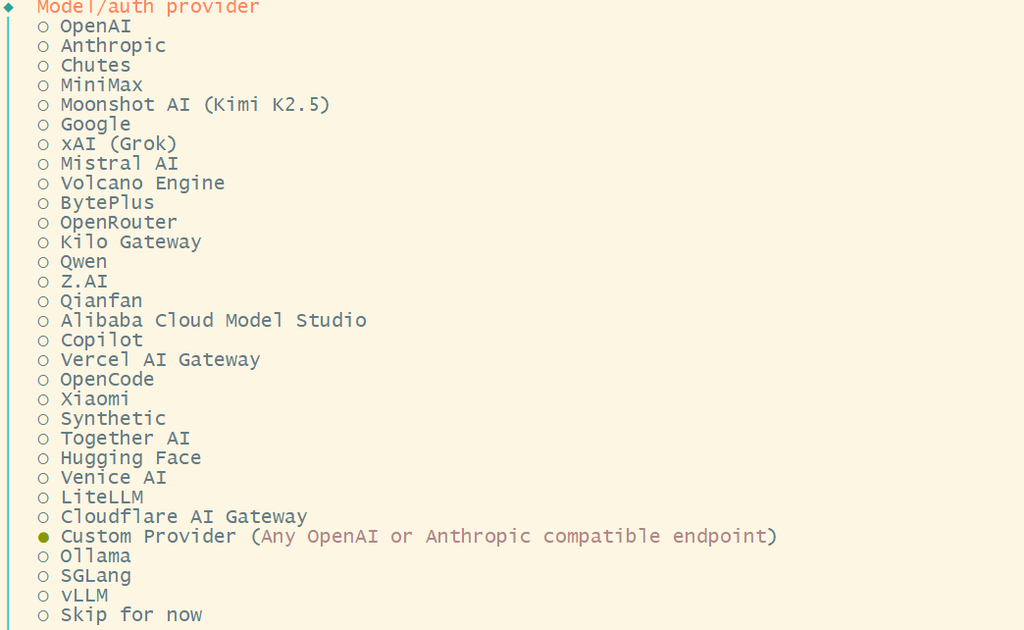

3.3 Model/auth Provider (模型验证)

内置的暂时不需要,我们选择Custom Provider 。

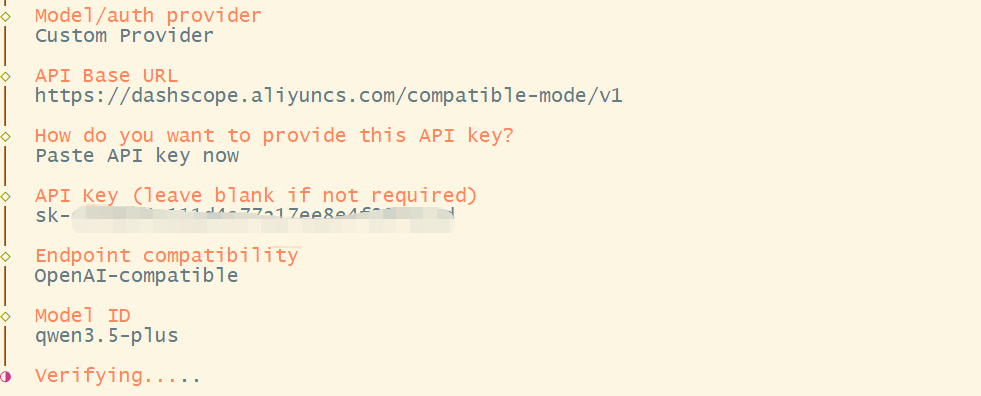

此时,会让你输入API Base URL,我们以阿里云百炼模型Qwen为例。

填入阿里云百炼模型URL,选择API Key验证,填写百炼模型的API Key,然后选择OpenAI-compatible,然后输入模型,目前免费体验的模型有qweb3.5-plus(100Wtoken),当然还有其他的这里只选择一个即可,后面的再添加就是了。

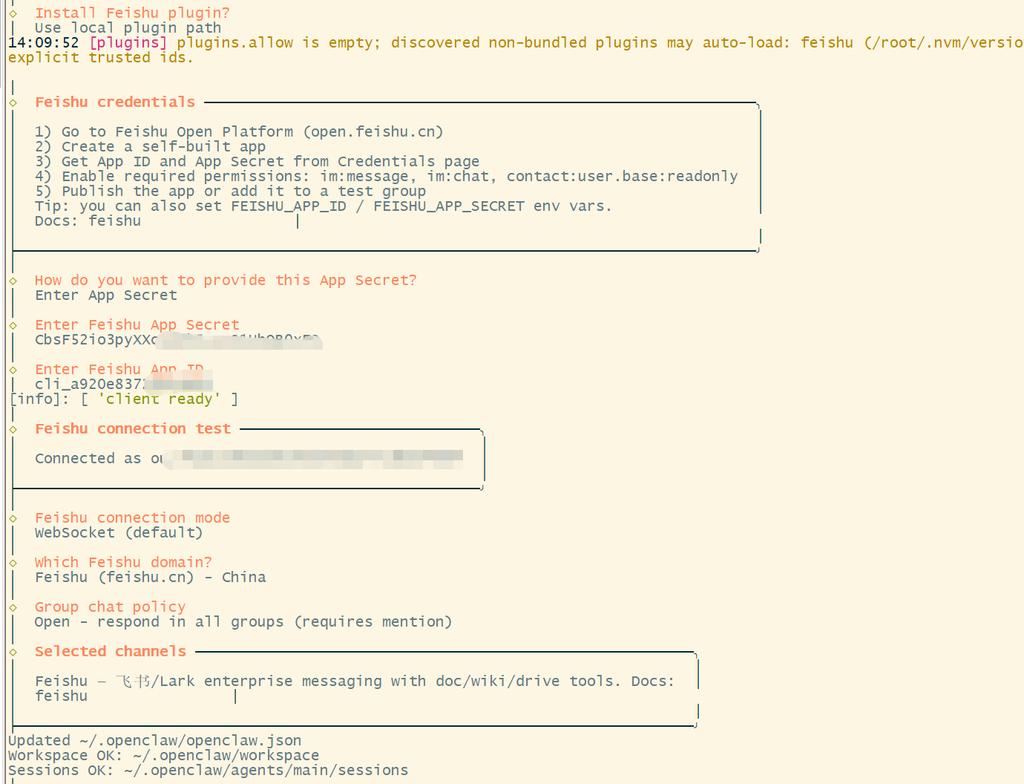

3.4 Select channel(选择哪个平台的机器人)

因为提前创建了飞书、钉钉的机器人,这里就选择飞书,如果没有任何机器人可以选择Skip for now(后续还可以再次添加和修改)。

选择使用自带的Feishu,然后填写相关信息

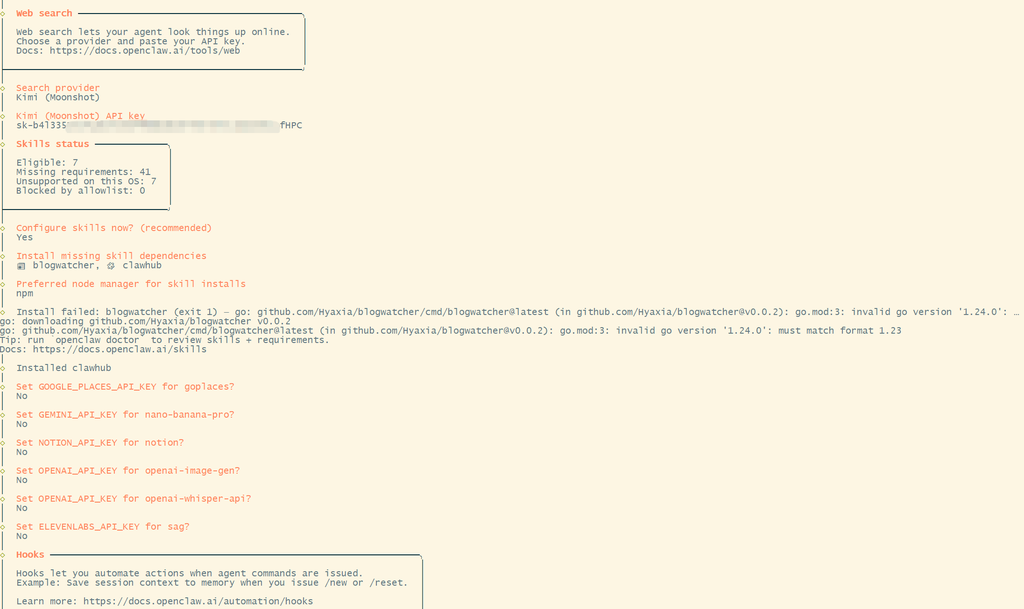

3.5 Web search

这个建议使用Kimi的吧,去Moonshot AI 开放平台 – Kimi K2.5 大模型 API 服务 创建一个Key,填写进去即可。其他的就随便。

此时就安装配置完成了。

3.6 自定义配置

后面就可以通古WebUI、修改配置文件、命令等方式进行自定义配置了。

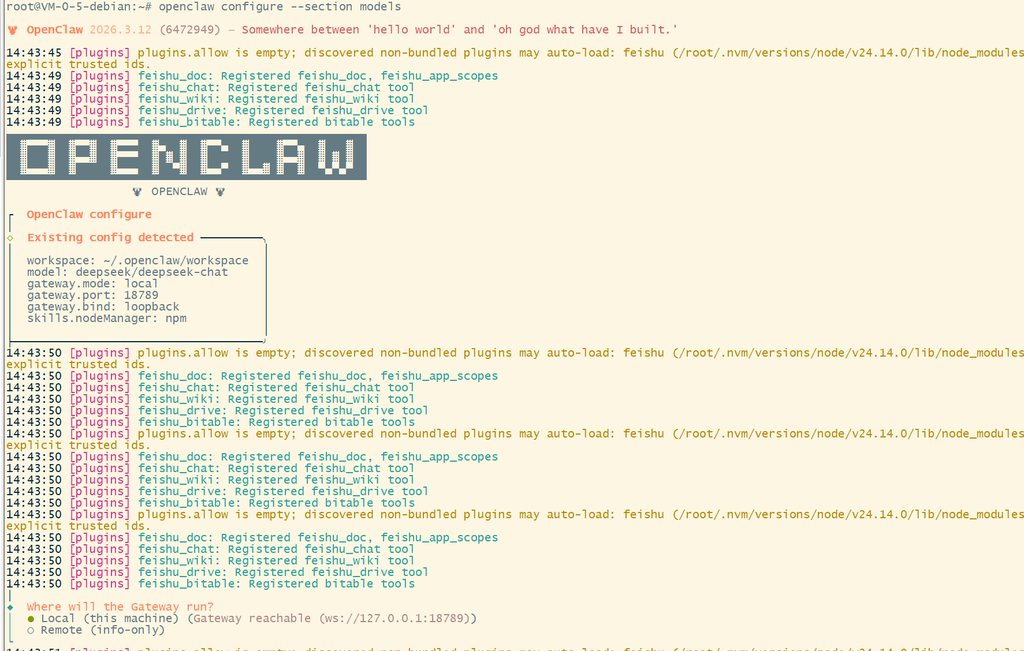

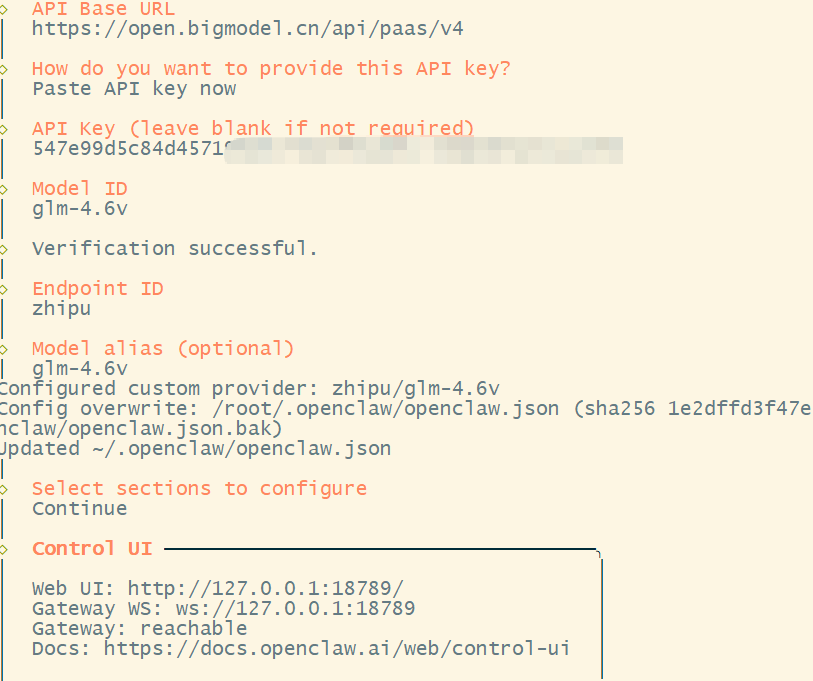

openclaw configure --section models

选择Local,然后一直到模型,继续选择Custom Provider,接着填写新模型

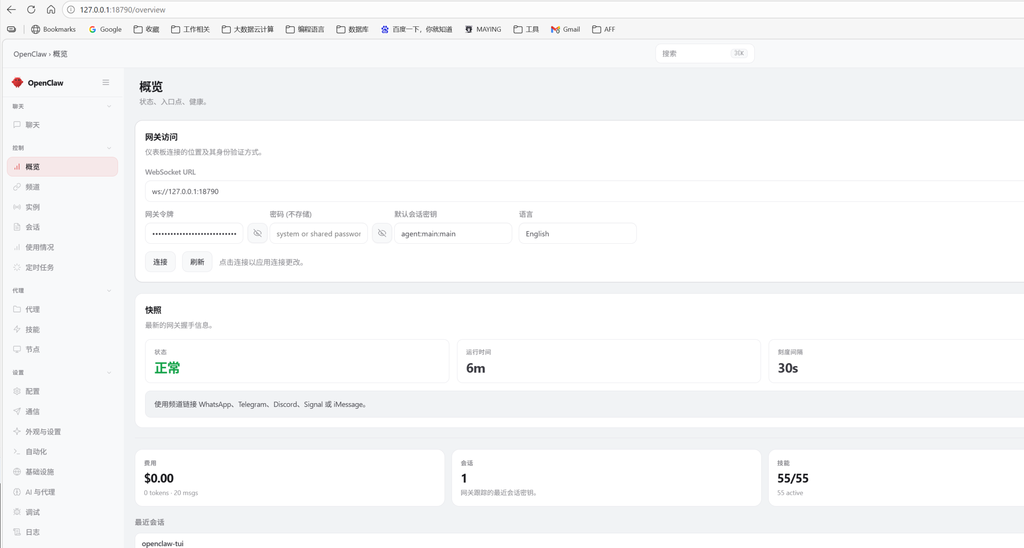

通过隧道在本地访问

默认OpenClaw只绑定127.0.0.1,也非常不建议大家为了方便去反向代理暴露在公网。通常我们使用SSH 隧道连接到这台服务器上,然后在本地打开。

ssh -i C:\Users\xxx\.ssh\vps-server -L 18790:127.0.0.1:18789 root@服务器IP地址- -i C:\Users\xxx\.ssh\vps-server,表示我是用本地名为vps-server密钥登陆。没配置SSH-KEY登录服务器的同学可以使用密码。

- -L 绑定端口。

登陆时需要一个token,或者你使用密码也行(需要自己修改配置)

Token,在你重启gateway时就可以看到

接入QQ

打开QQ开放平台,官方页面会有个OpenClaw快捷开通的链接,点击,创建机器人即可。

按照文档接入即可。